Marta Sánchez Viejo - Mié, 26/01/2022 - 14:20

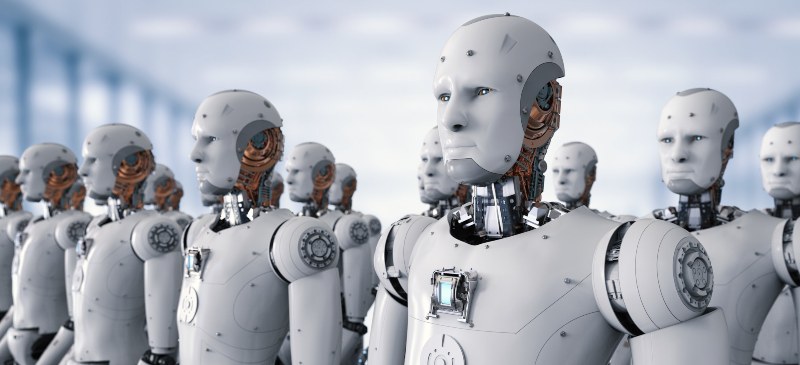

Los robots serán utilizados como armas en el futuro.

Serie: 'A vueltas con la Economía' (LXXV)

“Un robot no debe dañar a un ser humano o, por su inacción, dejar que un ser humano sufra daño”.

Así comenzaba Isaac Asimov a enunciar las Tres leyes generales de la robótica, pilares básicos de la ética en la robótica e IA. En la actualidad, sin embargo, estos principios parecen tambalearse por entrar en contacto con diferentes intereses económicos. Los conflictos bélicos son un campo de negocio lucrativo en la historia y el desarrollo tecnológico impacta sobre su dirección y evolución. El aumento del empleo de drones en terrenos de batalla interroga a la industria militar sobre sus umbrales y objetivos en el uso de la fuerza. Esta vía tecnológica es precursora del aumento de la automatización que, simultáneamente, ha generado dudas sobre la idoneidad de la creación y utilización de sistemas letales de armas autónomas.

Las armas autónomas o autonomous weapons son aquellas aptas para ejecutar una misión con supervisión humana limitada o sin ella. En la actualidad no son viables, pero se espera que lo sean en un futuro cercano y puedan operar sin presencia de personas. Esta dirección en el desarrollo militar ha alarmado a investigadores y expertos en IA y Gobiernos. Por esta razón, se creó en 2013 la Campaign to Stop Killer Robots, una asociación internacional destinada a la prohibición preventiva de las armas autómatas. También, más de cien expertos de veintiséis países manifestaron su oposición y alertaron del potencial riesgo que poseen las armas letales autónomas por medio de la redacción de un escrito abierto enviado a la ONU.

Un dron volando, utilizado como arma espía.

Los conflictos de guerra son fácilmente vinculables a dilemas éticos, pero ahora se presenta un nuevo escenario: no sólo por la autonomía de los robots que puede implicar la muerte de seres humanos, también en relación con los condicionantes en la toma de decisiones. Las acciones a ejecutar se basan en un análisis de datos configurados previamente por humanos, por lo que cabe preguntarse cómo y sobre qué parámetros se determinan estas decisiones.

A pesar de los posibles peligros, las ventajas económicas hacen que países como Reino Unido, China, Estados Unidos, Rusia o Israel apoyen su desarrollo. El Gobierno estadounidense, por ejemplo, lleva más de diez años apostando por un programa destinado a la Fuerza Aérea que se focaliza en proporcionar recursos para las armas autónomas con la finalidad de que actúen sin intervención humana una vez programadas. También, el Pentágono pretende invertir en el desarrollo de un modelo de robot destinado a completar ejércitos y ayudar en tareas de detección de sustancias peligrosas o carga de equipos y armas.

Se presenta un escenario complejo dónde no solo se debe de tener en cuenta la factibilidad de la mejora y progreso tecnológico, también, si es conveniente su desarrollo, aun poseyendo la capacidad de realizarlo. Las perspectivas de negocio son amplias, pero valorar la información sobre los posibles peligros y tener en cuenta otros factores, no sólo aquellos que se encuentran dentro del ámbito económico, es clave para mitigar posibles consecuencias negativas para la totalidad del planeta.

Bibliografía:

Salazar, I. (2019). La revolución de los robots: Cómo la inteligencia artificial y la robótica afectan a nuestro futuro (1ª ed.). TREA.

Horowitz, M. (2016). The Ethics & Morality of Robotic Warfare: Assessing the Debate over Autonomous Weapons. Daedalus.

Editor: Universidad Isabel I

Burgos, España

ISSN: 2659-3971